新聞中心

臺北市政府引進機器狗引發的討論,不僅揭示了資安風險,也將大眾目光引向機器人技術的深層變革。

在過去,各界對機器人的印象,多半停留在工業生產線上的傳統機器手臂,或依循預設路徑巡邏的自動化載具。

這些傳統機器人主要仰賴「固定程式、路徑規劃、傳感器規則」來運作,本質上是一種「自動化工具」。VicOne LAB R7實驗室負責人張裕敏表示,傳統機器人能夠精確地重複執行預設動作,例如搬運物品、跳舞,但一旦環境發生變化或遇到未知情境,便會顯得笨拙且無能為力,因為它們缺乏真正的「理解」和「推理」能力。

從傳統機器自動化到具身AI機器人,相關產品技術發展大躍進

隨著人工智慧,特別是大型語言模型(LLM)的飛速發展,機器人正經歷一場智慧心靈的覺醒,轉型為具備學習、理解與應變能力的「具身AI機器人」。

張裕敏也定義了什麼是「具身AI(Embodied AI)」機器人,他指出,具身AI不單純是存在於軟體或雲端的AI(如ChatGPT),而是「像人類具備五感」、「有身體」並能在物理世界中感知、行動、學習的人工智慧。

他進一步解釋,這些具身AI機器人的核心特徵,包括:第一種就是感知(Perception)能力,可以透過多種感測器,如相機、麥克風、雷射雷達(LiDAR)、觸覺感測器等,來理解周遭環境,模仿人類的眼、耳、鼻、舌、身、意;其次是具備行動(Action)能力,可以透過馬達、手臂、腿或輪子等物理方式,與環境進行互動。

第三種則是學習與適應(Learning & Adaptation)能力,與傳統機器人只依賴預先編寫的規則不同,具身AI機器人更能透過經驗、強化學習或大模型推理,持續改進自身的行為與決策。

最後則是語言與推理能力,因為新一代具身AI機器人的關鍵特色,就是能夠理解人類的自然語言指令,並結合世界知識進行高階決策。

張裕敏進一步解釋,「具身AI」的定義,第一個層次是「外部模仿人類所有感知」;第二個層次則是「模仿人頭腦中的各式推移」,這就體現了具身AI所具備的「理解(reasoning)」和「推論(inference)」能力。

他舉例說明,傳統AI(機器學習ML)在辨識出「這是可樂」後,任務就結束了;但新型的具身AI機器人則會進一步「思考」:「你(人類)為什麼要拿可樂給『我』(機器人)?」可能是因為你打不開,所以機器人會主動幫你打開;或者它會根據你拿東西的反應,判斷你是在邀請它,便會把可樂拿起來並說謝謝。

這種「具身AI」機器人演繹了所謂的「視覺語言動作模型(VLA)」或「視覺語言模型(VLM)」。張裕敏強調,VLA模型是大型語言模型(LLM)的下一步演進,讓機器人不僅能看(Vision)、能聽(可聲控),還能模仿(Action)人類的動作。

事實上,變聰明的具身AI機器人,已經能做許多傳統機器人無法想像的事情。VicOne LAB R7實驗室研究員駱一奇表示,以往工廠的傳統機器手臂,雖然效率高,但只要生產線稍有變動,就需耗費大量時間重新規畫與設定。

不過,他表示,搭載VLA模型的具身AI機器人,則能展現極高的彈性。它們可以自行學習,例如當一個生產線的料件不足時,它們能自動轉移到另一個生產線協助;或者在現有任務完成後,根據需求轉換任務。

張裕敏則形容,這種具身AI機器人表現的就像是「資深廠長」、「資深研究員」甚至是「資深師傅」,能夠當場進行各種測試與微調,甚至學習最佳的運作方式。

物理AI的發展潛力無窮,應用的規模將大於純雲端AI

輝達創辦人、總裁暨執行長黃仁勳在2024年Computex(臺北國際電腦展)的主題演講,提出物理AI(Physical AI)概念,揭開AI機器人市場應用的新篇章。

他說:「我們正在進入新的AI 時代,不只是數位世界的AI,而是能在物理世界裡感知、推理,並且採取行動的物理AI。」

黃仁勳強調,Physical AI會讓工業革命進入全新階段,AI不只是提供建議,而是能直接影響現實世界,也會推動新一波製造業、自駕車、醫療、機器人的大革命,「規模甚至大於純雲端AI。」他說。

AI不只在雲端,也要走向物理世界,從處理文字、圖片的「數位AI(Digital AI)」,進化到能理解並操作現實世界的「物理AI(Physical AI)」,它需要感測器(Sensors)加上即時推論(Real-time Inference)能力以及機器(Robotics/Automation)。

因為AI必須與感測器結合,才具備「理解環境」的能力,感測器包括:相機、雷射雷達(LiDAR)、醫療影像、工廠感測器……等,都能輸入AI模型;這些AI模型需要能做到「即時推理」,才能做出實際動作。

若要更具體理解「物理AI」概念,我們可以這麼看:機器人對真實世界中的物理狀況具備理解力,例如:機器手臂在抓取物品時,不會盲目地撞破桌子;看到電線,它會知道要從插頭拔起,而不是硬扯斷。張裕敏表示,具身AI機器人這種對物理世界的認知,是傳統機器人難以企及的。

另外,駱一奇也表示,輝達更是利用數位分身(Digital Twin)平臺進行AI訓練,讓機器人在虛擬環境進行數百萬次的模擬學習,大大提升了訓練效率和模型精準度,減少物理訓練所需的時間和成本;而外面的機器人業者更可以直接站在巨人(輝達)的肩膀上,運用其已經訓練好的模型,訓練自己的具身AI機器人或機器狗。

具身AI與傳統機器人的本質差異

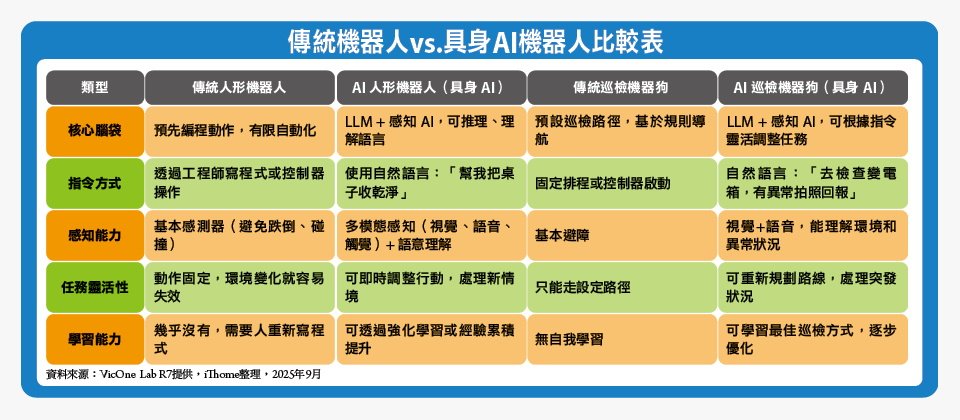

雖然從外觀上,我們很難一眼分辨一臺機器手臂或機器狗是「傳統」還是「具身AI」,兩者在核心設計與能力上卻有著天壤之別。

張裕敏點出,機器人與機器狗在「行動能力」存在差異,例如:兩足人形機器人需要更複雜的平衡系統,具備舉重能力及靈活手部關節,對人有較高的威嚇性,甚至可以踢人或抱住人。

至於四足機器狗則更容易平衡,以支撐為主,體型小巧、靈活,能鑽入傳統機器人難以到達的狹小空間進行瓦斯或水管檢測,但通常不會咬人,短期內對人沒有威嚇性。

然而,這些物理差異並非本質,張裕敏坦言:「真正的區別在於其『大腦』的智慧層次,以及賦予的『任務』不同,進而決定它們搭載的裝備與能力。」

傳統機器人就像是機械動作的「工具」,腦袋是「寫死的程式」;具身AI機器人,則是會聽懂、會判斷、能學習的「智慧助手」,腦袋是「能理解語言、推理、學習的AI」。

至於傳統巡檢狗,像是「自動巡邏車」,具身AI巡檢狗則更像是「會理解你要什麼」的智慧巡檢助手。張裕敏表示,這場從「工具」到「智慧助手」的演變,將會徹底改變我們與機器互動的方式。

各界對具身AI面臨的資安風險認知不足,建立標準、實施檢測有必要

當具身AI機器人從工廠的封閉生產線,大步邁入公共場域與家庭,我們所面臨的資安挑戰,將不再僅限於網路竊取或網路攻擊,而是可能直接威脅到物理世界的安全與人類的生命財產。

張裕敏對於未來五年「具身AI」機器人或機器狗的資安發展,提出警示:「這將是一個『戰國時代』」。

他強調,目前大眾對機器人資安的認識仍顯不足,臺北市政府引進機器狗所引發的爭議,恰好是一個絕佳的警醒:若不加以重視,三年後,當機器人已經更廣泛應用時,我們恐將面臨一場「大災難」。

他也進一步分析,具身AI的資安防護面臨的核心安全困境。首先,對於軟硬體結構缺乏深入了解,自然就難以意識到潛在的資安風險。

他解釋,如同我們不會知道一臺機器人內部,包含作業系統(OS)、中介軟體(middleware)、韌體(firmware)、嵌入式控制器(ECU/MCU)等複雜層次。但如果我們不了解這些底層架構,便無法真正找出其安全漏洞。

其次,AI機器人面臨的資安問題,不僅包含傳統IT產業、工業控制(OT)、物聯網(IoT)的挑戰,更加入AI模型這個快速演進的新變數。張裕敏指出,因為AI發展快速,使得攻擊面廣泛且快速演進、不斷擴大,資安人員疲於奔命。

第三,就是機器人業者對於「功能」與「威脅」,存在基本的認知差異。如同中國宇樹科技機器狗的「遠端遙控」功能,機器人廠商視為是產品的「必要功能」,這就與IT或資安業者對於遠端遙控是資安風險的認知不同。

「畢竟,遠端關機功能,在機器人失控時,的確是確保安全的手段,但資安專家將其視為潛在的後門。」張裕敏指出,這種認知上的根本差異,是資安防護上的一大挑戰。

第四,有關於VLA和VLM模型的新變數。他表示,具身AI採用的VLA或VLM模型,因其結合了視覺、語言與動作,若外界給予機器人「口心不一」的指令,例如嘴巴說「放下」,使用者卻做出「拿起」的動作時,就可能導致機器人學習到錯誤的行為,進而產生資料或行為衝突,甚至AI機器人可能因此被訓練出「AI後門」,亦即可以在「特定條件下」做出攻擊行為。

最後,其實也是全世界因應AI機器人逐漸成熟發展時,目前共同面臨的困境,那就是:機器人資安法規與標準存在的巨大真空。

張裕敏指出,現有的國際標準,例如:工業機器人的ISO 10218-2、安全性標準IEC 62443或AI治理的NIST CSF 2.0/AI RMF,都未能完全適用於「具身AI」這種新型態的機器人。

他認為,因為沒有專門針對具身AI的法規或安全標準,也導致政府或企業在引進這類產品時,難以有明確的資安檢核依據。廠商往往只能以最低的成本提供功能最好的產品,卻無法在資安方面進行有效的驗證。

因此,隨著這類具身AI機器人發展迅速且日趨成熟下,張裕敏也呼籲:「臺灣應該要有機器人安全的標準或法案出來」。一旦有了法規,廠商便會主動符合,並會有一系列配套的稽核與驗測機制,也能成為產業和政府在選擇與部署AI機器人時的重要參考。

他強調,即使是通過驗測的產品仍有風險,但「有通過驗測、雖然有風險,總比什麼都沒有好」,因為,標準至少是最低限度的資安要求,有助於防止駭客輕易入侵。

具身AI機器人安全問題,已達必須正視的資安臨界點

「具身AI機器人安全問題,已經達到資安臨界點。」張裕敏表示,日前已發生數起震驚業界的事件,例如「中國一個機器人測試期間,機器人『集體罷工』」,甚至出現「機器人狠殺比亞迪工人」的驚悚案例。

面對這些駭人聽聞的事件,他認為,具身AI機器人面臨的資安風險,不僅是單純的技術故障,更預示著在「具身AI」時代,機器人可能面臨前所未有的資安挑戰。

當AI機器人的應用場景多元化,從工廠走入你我家中,應用於長照、陪伴、醫療、倉儲運輸等領域時,好處是,這個世界可能變得更安全,例如:巡檢機器人能提升安全、降低犯罪率;但是,這也意味著資安問題將變得更加嚴重,因為機器人與人類生活的結合將更為緊密,任何漏洞都可能帶來更大的實體和資安風險。

張裕敏指出,中國解放軍早在十年前就已開始使用機器人,無人機更是從2003年便開始發展。他表示,這些AI機器人可能改變戰爭模式,大幅提升作戰效率,但這也為資安帶來了更高的戰略風險。

以具身AI機器人的發展來看,張裕敏表示,雖然機器人使用的VLA或VLM的AI模型仍掌握在美國手中,但中國利用人口基數大、地域廣闊的優勢,進行大規模的實驗與測試,甚至以真實城市作為實驗場域,加上國家資金的無限制投入、鼓勵技術竊取或收購,使其能「先偷出來、先做出來」,節省數十年發展的時間與數百億的研發成本,快速搶佔市場,讓中國在機器人領域快速崛起並形成強大的競爭優勢。

張裕敏認為,臺灣若想在AI機器人的資安領域有所突破,也必須要開放相關的產業場域,並大量投入機器人應用,因為,「當你有大量投入機器人應用時,相關的資安問題,才會顯現出來。」他說道。

不同於汽車產業從硬體走向「軟體定義汽車(SDV)」,張裕敏指出,各種機器人從一開始,就是以「軟體定義」的思維來設計,它們大量使用數位分身(Digital Twin)在虛擬場景中進行模擬訓練,然後再將訓練好的模型移植到實體硬體上。可以說,機器人是「原生即軟體定義」的產物,這也使得其軟體更新與功能迭代速度極快,對於資安防護也帶來新的挑戰。

臺北市政府引進巡檢機器狗引發的資安爭議,絕非單一事件,要如何從這樣的事件中汲取教訓,進而更有效率、更有自信地面對具身AI機器人的發展,是大家在迎接具身AI時代即將全面來臨時,必須要面對的挑戰縮影與預警。

張裕敏強調,首先要做到資訊透明化,公開透明地揭露所引進高科技產品的來源、技術規格及潛在風險,讓民眾有知情權,共同監督。

其次,臺灣應盡速研擬並建立針對具身AI機器人,明確的安全標準與法規,不僅能為產品採購提供明確依據,更能促使廠商提升資安防護等級,確保技術應用安全可靠。

第三,持續投入資源,深化對機器人軟硬體、AI模型(特別是VLA/VLM)的資安研究,並進行實戰化的攻防演練,提前發現並修補潛在漏洞。

第四,也是張裕敏最在意的議題就是,對於機器人的產品採購與部署上,必須明確定義「主控權」的歸屬,以確保使用者能在必要時擁有最高層級的控制權,而非受制於原廠的遠端遙控,避免「功能」與「威脅」認知差異帶來的風險。